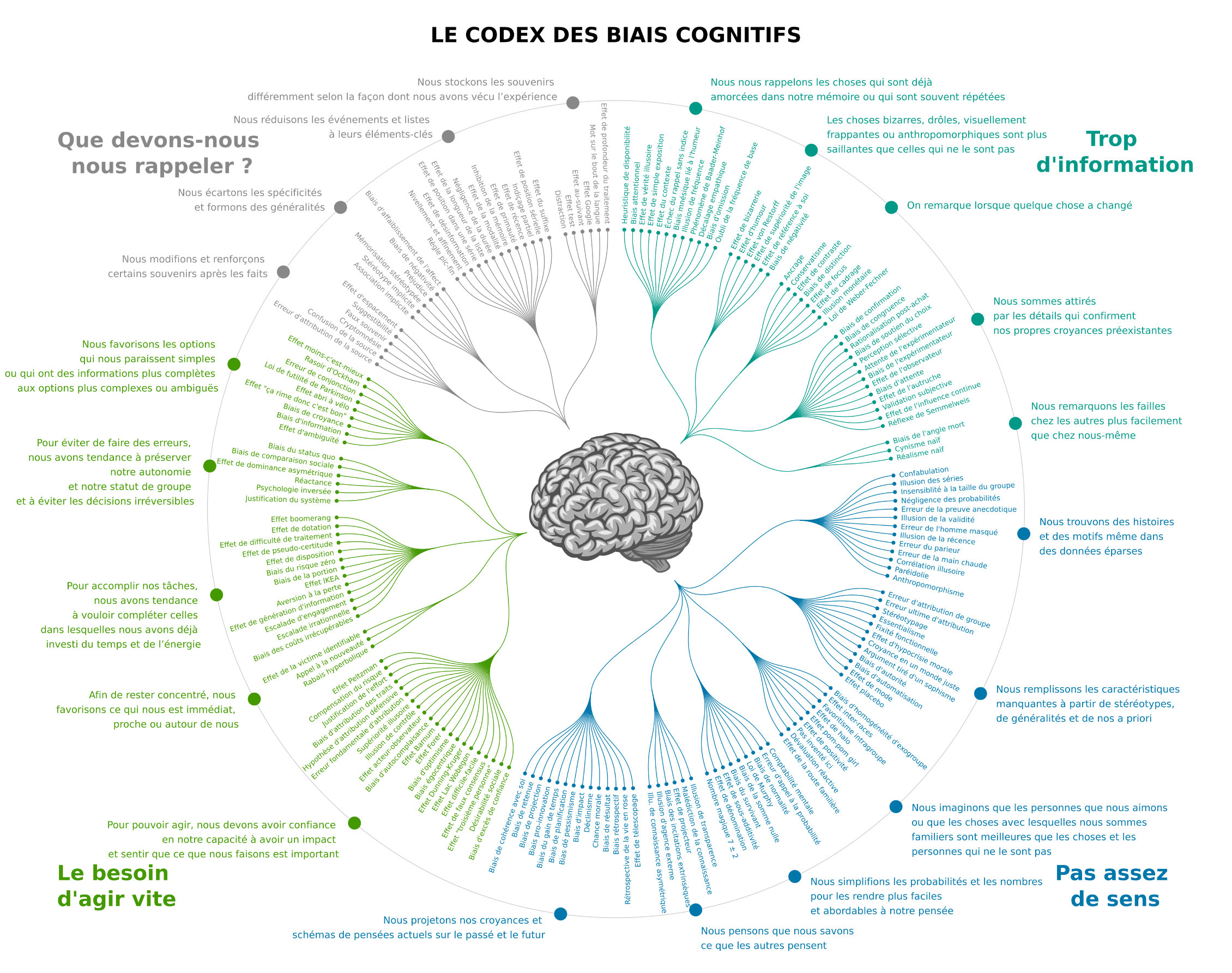

LE CODEX DES BIAIS COGNITIFS

Crédits :

Cet article s’appuie sur le Codex des biais cognitifs de John Manoogian III (jm3), basé sur le travail de Buster Benson.

Source originale : The Cognitive Bias Codex (French), disponible sur Wikimedia Commons.

Contexte: Le Codex des biais cognitifs (Cognitive Bias Codex) créé par John Manoogian III (jm3) est une infographie visuelle qui organise et classifie les biais cognitifs humains de manière systématique. Il s’agit d’une représentation synthétique des distorsions de la pensée qui influencent nos jugements, nos décisions et nos perceptions.

Objectif : Difficilement consultable sur mobile par exemple, cet article reprend les 188 biais cognitifs sous forme de texte avec onglets en respectant les groupes et sous-groupes.

De plus, pour faciliter la consultation, chaque biais est résumé en une phrase et accompagné d’un exemple concret plutôt orienté « webmarketing, communication digitale ». Vous retrouverez également un lien vers le fichier source Wikimedia.

Pas assez de sens

Nous trouvons des histoires et des motifs même dans des données éparses

- Confabulation ( 🔗confabulation)

La confabulation est la tendance à combler les trous de notre mémoire ou de notre compréhension en inventant, sans s’en rendre compte, des explications ou des souvenirs qui paraissent cohérents mais qui sont faux ou déformés. Notre cerveau préfère une histoire complète, même inexacte, à un « je ne sais pas », et produit donc des récits plausibles pour donner du sens à ce qui nous échappe.

Exemple : quelqu’un raconte en détail un dîner qu’il croit avoir eu le week‑end précédent chez des amis, avec des plats et des conversations précises, alors que ce dîner avait en réalité eu lieu plusieurs mois plus tôt, ou même dans un autre contexte, sans qu’il cherche à mentir. Illusion des séries (🔗clustering illusion)

Nous avons tendance à croire que le hasard devrait être « bien réparti », sans « paquets » ni séries, et quand nous voyons des regroupements, nous pensons qu’ils cachent forcément un motif ou une cause particulière. En réalité, les séries et les regroupements sont parfaitement normaux dans des séquences aléatoires, mais notre cerveau les interprète comme des « signes ».

Exemple : en voyant que le bus arrive trois fois de suite en retard, quelqu’un se dit que « ce conducteur ne respecte jamais les horaires », alors que ce sont juste trois coïncidences dans un flot de trajets bien à l’heure.Insensibilité à la taille du groupe (🔗Insensitivity to sample size)

Ce biais nous pousse à donner autant de poids à une petite poignée de cas qu’à une grande étude, comme si 3 exemples valaient 3 000 données. Nous oublions que les petits échantillons produisent plus facilement des résultats extrêmes ou trompeurs, ce qui rend nos conclusions fragiles.

Exemple : après avoir rencontré deux touristes désagréables dans un pays, une personne conclut que « les gens de ce pays sont froids », sans se rendre compte que deux rencontres ne représentent absolument pas toute une population.Négligence de la probabilité ( 🔗Neglect of probability)

Nous tenons souvent compte de la couleur émotionnelle d’un événement (effrayant, marquant, rare) plutôt que de sa probabilité réelle. Nous surestimons les risques spectaculaires et sous-estimons les risques quotidiens, simplement parce que certains scénarios frappent plus notre imagination.

Exemple : quelqu’un a très peur de prendre l’avion à cause des crashs vus aux infos, mais traverse sans réfléchir des routes très fréquentées, alors que le risque d’accident de voiture est statistiquement bien plus élevé.Erreur de la preuve anecdotique ( 🔗Preuve_anecdotique)

Nous laissons une ou quelques histoires fortes prendre le pas sur des données plus larges. Une anecdote vécue ou racontée par un proche nous semble plus « vraie » qu’une statistique, même si elle ne représente qu’un cas isolé.

Exemple : parce qu’une amie a eu un effet secondaire rare avec un vaccin, une personne décide que « les vaccins sont dangereux », en ignorant des millions de cas où tout s’est bien passé.Illusion de validité ( 🔗Illusion of validity)

Nous pouvons être très confiants dans un jugement ou une impression simplement parce qu’ils sont détaillés, cohérents ou présentés avec assurance. Cette sensation de clarté nous fait oublier que les informations de départ sont parfois très limitées ou biaisées.

Exemple : après avoir vu un horoscope très général mais bien tourné, quelqu’un se dit « c’est exactement moi, cette astrologue me connaît vraiment », alors que le texte pourrait s’appliquer à presque tout le monde.Corrélation illusoire ( 🔗illusion de cause)

Nous percevons un lien entre deux événements parce qu’ils se produisent ensemble ou se suivent, et nous en déduisons facilement une cause alors qu’il ne s’agit que d’une coïncidence. Notre esprit préfère une histoire causale simple plutôt que l’idée de hasard.

Exemple : une personne remarque qu’elle tombe souvent malade après des périodes de stress au travail et conclut que « dès que mon chef me presse, je tombe malade », en oubliant que ces périodes coïncident aussi avec l’hiver et les virus saisonniers.Erreur du parieur ( 🔗gambler’s fallacy)

Ce biais consiste à croire que le hasard a une mémoire, et que les résultats passés influencent les prochains dans un sens de « compensation ». On pense qu’une longue série d’un résultat augmente la probabilité de voir apparaître le résultat opposé.

Exemple : en jouant à pile ou face, après cinq « pile » de suite, quelqu’un parie fort sur « face » en se disant « cette fois c’est sûr, ça va tomber », alors que la probabilité reste 50/50 comme à chaque lancer.Illusion de la main chaude ( 🔗hot‑hand fallacy)

À l’inverse, ce biais nous fait croire qu’une série de succès est le signe d’une sorte de « veine » ou de talent momentanément amplifié, qui va forcément se poursuivre. On voit une continuité là où il n’y a parfois qu’une succession de hasards favorables.

Exemple : en jouant à un jeu de cartes, une personne gagne plusieurs parties d’affilée et se dit « aujourd’hui je suis en forme, je gagne tout », et se met à augmenter ses mises, alors que sa série gagnante peut être purement aléatoire.Paréidolie ( 🔗pareidolia)

La paréidolie nous amène à voir des images familières dans des formes vagues ou chaotiques : visages dans les nuages, animaux dans des taches, silhouettes dans les ombres. Notre cerveau préfère reconnaître quelque chose de connu plutôt que d’accepter l’irrégularité.

Exemple : en regardant la lune, quelqu’un dit qu’il voit « un visage » ou « un lapin », alors qu’il ne s’agit que de la disposition aléatoire des zones claires et sombres sur la surface.Anthropomorphisme ( 🔗anthropomorphism)

Nous prêtons volontiers des intentions, émotions ou pensées humaines à des animaux, des objets ou même des phénomènes naturels. Cela rend le monde plus compréhensible et plus proche de nous, mais peut fausser notre compréhension.

Exemple : une personne dit que sa voiture « est fâchée » parce qu’elle ne démarre pas quand il pleut, ou que son ordinateur « décide de buguer au mauvais moment », comme si ces objets avaient une volonté propre.Erreur de l’homme masqué ( 🔗masked‑man fallacy)

Ce sophisme apparaît quand on conclut que deux descriptions ne peuvent pas désigner la même personne parce qu’on ne fait pas le lien entre elles. On confond ce que l’on sait (ou ignore) avec ce qui est réellement le cas, et on en tire une conclusion erronée.

Exemple : quelqu’un dit « je connais très bien mon voisin, je ne connais pas la personne qui a gagné à la loterie dans mon quartier, donc ce n’est pas mon voisin », alors qu’il se peut très bien que le voisin ait gagné sans lui en parler.- Illusion de la récence ( 🔗 Recency bias)

L’illusion de la récence (ou biais de récence) est la tendance à accorder beaucoup plus de poids aux événements les plus récents qu’aux plus anciens, comme si ce qui vient de se produire reflétait mieux la réalité générale. On a alors l’impression que quelque chose « arrive tout le temps en ce moment », simplement parce qu’on a commencé à y prêter attention ou que les derniers exemples sont très présents dans notre mémoire.

Exemple : après avoir vu deux reportages coup sur coup sur des cambriolages dans sa ville, une personne a le sentiment que « maintenant, on se fait cambrioler partout », alors que les statistiques globales n’ont presque pas changé.

- Confabulation ( 🔗confabulation)

Nous remplissons les caractéristiques manquantes à partir de stéréotypes, de généralités et de nos a priori

Stéréotypage ( 🔗stereotype)

Nous attribuons automatiquement des traits à une personne en fonction de son appartenance supposée à un groupe (âge, genre, origine, métier…), sans la connaître.

Exemple : voir un adolescent avec une capuche et penser immédiatement « il doit être perturbateur » ou « peu sérieux », simplement à cause de son apparence et de son âge.Erreur d’attribution de groupe ( 🔗group attribution error)

Nous généralisons à tout un groupe ce que nous avons observé chez quelques membres, comme si deux ou trois exemples suffisaient à décrire tous les autres.

Exemple : après avoir rencontré deux touristes bruyants d’un pays donné, quelqu’un affirme ensuite que « les gens de ce pays font toujours beaucoup de bruit ».Erreur d’attribution ultime ( 🔗ultimate attribution error)

Nous expliquons les comportements négatifs d’un groupe extérieur par leur « nature » ou leur culture, alors que pour notre propre groupe, nous invoquons plutôt des circonstances particulières.

Exemple : si un voisin qu’on apprécie jette un papier par terre, on se dit « il a dû le faire par inadvertance », mais si c’est un inconnu d’un autre groupe, on pense « ces gens-là ne respectent jamais rien ».Essentialisme ( 🔗essentialism)

Nous croyons que certains groupes possèdent une « essence » interne, fixe, qui expliquerait leurs comportements, comme si ces traits étaient naturels et immuables.

Exemple : affirmer que « les garçons sont naturellement moins sensibles » ou que « les filles sont naturellement plus bavardes », comme si ces différences venaient d’une essence biologique plutôt que d’éducation et de contexte.Croyance en un monde juste ( 🔗just-world fallacy)

Nous avons tendance à croire que le monde est fondamentalement juste, et que les gens obtiennent ce qu’ils méritent, ce qui conduit à blâmer les victimes.

Exemple : entendre parler d’une personne qui a perdu son emploi et penser « elle n’a sûrement pas assez travaillé » plutôt que d’envisager un licenciement économique ou des circonstances indépendantes de sa volonté.Biais d’autorité ( 🔗authority bias)

Nous accordons plus de poids à l’avis d’une personne perçue comme figure d’autorité (titre, uniforme, statut), même si elle ne donne pas de bonnes raisons ou de preuves solides.

Exemple : croire une affirmation sur la nutrition juste parce qu’elle est dite par quelqu’un en blouse blanche dans une vidéo, sans vérifier s’il est vraiment nutritionniste ou s’il cite des sources fiables.Biais d’automatisation ( 🔗automation bias)

Nous faisons trop confiance aux recommandations d’un système automatisé (GPS, logiciel, algorithme) et avons tendance à ignorer des signaux évidents qui montrent qu’il se trompe.

Exemple : suivre le GPS qui indique de tourner dans un chemin de terre dangereux, alors que les panneaux et la situation réelle montrent clairement que ce n’est pas une route pour voitures.Effet de troupeau / effet de mode ( 🔗bandwagon effect)

Nous adoptons une croyance ou un comportement principalement parce que beaucoup de personnes autour de nous semblent le faire, ce qui renforce la popularité de certaines idées.

Exemple : se mettre à utiliser un nouveau réseau social dont on n’a pas vraiment envie, simplement parce que « tout le monde a l’air d’y être » parmi ses amis.Fixité fonctionnelle ( 🔗functional fixedness)

Nous avons du mal à imaginer de nouveaux usages pour un objet en dehors de sa fonction habituelle, ce qui limite notre créativité pour résoudre des problèmes.

Exemple : ne pas penser à utiliser une ceinture comme sangle pour attacher quelque chose sur un vélo, parce qu’on la voit uniquement comme un accessoire pour tenir un pantalon.- Effet d’hypocrisie morale ( 🔗ou effet de compensation / crédit moral, self licensing)

Désigne la tendance à se permettre ensuite un comportement moins moral après avoir fait quelque chose que l’on perçoit comme « bien » ou vertueux.

Après une bonne action qui améliore l’image que l’on a de soi, on se sent inconsciemment autorisé à relâcher ses standards moraux, souvent avec des effets négatifs plus importants que le gain initial.

Exemple du quotidien : quelqu’un choisit une salade « saine » au restaurant, puis s’autorise un gros dessert très gras et sucré en se disant « je peux me le permettre, j’ai été raisonnable », alors qu’il n’aurait peut‑être pas pris ce dessert sans la première « bonne » décision. - Argument tiré d’un sophisme ( 🔗Argument de l’erreur/Argument from fallacy)

Erreur de raisonnement qui consiste à croire que, parce qu’un argument est mal formulé ou contient une faute logique, sa conclusion est forcément fausse. En réalité, un mauvais argument peut très bien aboutir à une conclusion vraie par hasard ou pour d’autres raisons, et ce biais nous pousse à jeter la conclusion avec l’argument, au lieu de l’examiner séparément.

Exemple du quotidien : quelqu’un explique très mal pourquoi fumer augmente le risque de maladie, en mélangeant les chiffres et les notions médicales. Un interlocuteur répond alors : « Ton raisonnement est n’importe quoi, donc fumer n’est pas si dangereux que ça », ce qui est faux : le fait que l’explication soit bancale ne rend pas la conclusion fausse. - Effet placebo ( 🔗Placabo)

L’effet placebo désigne le fait qu’un traitement sans principe actif (pilule neutre, faux médicament, procédure factice) peut produire de réels effets ressentis simplement parce que la personne croit qu’il va l’aider. Les attentes positives, le contexte médical et la relation avec le soignant modifient la perception de la douleur, du stress ou d’autres symptômes, sans que le produit lui‑même ait d’action pharmacologique spécifique.

Exemple du quotidien : une personne prend un comprimé présenté comme un puissant antidouleur alors qu’il ne contient en réalité que du sucre, et ressent pourtant une nette diminution de sa douleur dans l’heure, uniquement parce qu’elle est convaincue d’avoir reçu un vrai médicament.

Nous imaginons que les personnes que nous aimons ou que les choses avec lesquelles nous sommes familiers sont meilleures que les choses et les personnes qui ne le sont pas

Biais d’homogénéité d’exogroupe ( 🔗Out-group homogeneity)

Nous avons tendance à voir les membres d’un groupe extérieur (un autre pays, une autre culture, un autre « camp ») comme « tous pareils », en minimisant leurs différences individuelles, alors que nous percevons une grande diversité au sein de notre propre groupe.

Exemple : dire « les Parisiens sont tous arrogants » ou « les provinciaux sont tous gentils » comme si chaque personne de ces groupes avait la même personnalité.Effet inter‑races ( 🔗cross‑race effect / effet d’appartenance ethnique)

Nous reconnaissons plus facilement les visages de notre propre groupe ethnique que ceux d’autres groupes, que nous trouvons plus « similaires » entre eux, ce qui peut entraîner des confusions d’identité.

Exemple : avoir beaucoup de mal à distinguer plusieurs collègues d’une autre origine que la sienne au début, alors qu’on différencie très vite des collègues de son propre groupe.Favoritisme intragroupe ( 🔗in‑group bias / in‑group favoritism)

Nous évaluons plus positivement et favorisons spontanément les membres de notre propre groupe (famille, équipe, région, communauté) par rapport aux autres, même sans raison objective.

Exemple : trouver qu’un inconnu portant le maillot de « son » club de foot est « forcément sympa », alors qu’on se méfie davantage d’une personne portant le maillot du club rival.Effet de halo ( 🔗halo effect)

Une caractéristique très positive ou très négative (beauté, sympathie, prestance) colore notre perception globale d’une personne ou d’un objet, nous poussant à lui attribuer d’autres qualités ou défauts sans preuve.

Exemple : trouver quelqu’un « sûrement très compétent » simplement parce qu’il est bien habillé et s’exprime avec assurance lors d’une première rencontre.Effet pom‑pom girl ( 🔗cheerleader effect)

Les personnes nous paraissent plus attirantes lorsqu’elles sont vues en groupe que lorsqu’elles sont vues seules, car notre cerveau fait une sorte de « moyenne » visuelle qui lisse les imperfections individuelles.

Exemple : trouver un groupe d’amis croisés dans un bar très séduisant dans l’ensemble, puis, en revoyant certains individus isolés plus tard, les trouver nettement moins attirants que dans le groupe.Effet de positivité ( 🔗positivity effect)

Nous avons tendance, surtout en vieillissant, à retenir et privilégier davantage les informations positives que les négatives, ce qui colore notre souvenir des événements et des personnes.

Exemple : se souvenir surtout des bons moments d’un voyage (paysages, rencontres) et minimiser dans ses souvenirs les galères de transport ou les disputes sur place.Pas inventé ici ( 🔗not invented here)

Nous avons un réflexe de méfiance ou de rejet envers les idées, produits ou solutions venant de l’extérieur, simplement parce qu’ils n’ont pas été créés par « notre » groupe ou nous‑mêmes.

Exemple : une équipe refuse d’utiliser une méthode déjà éprouvée parce qu’elle vient d’une autre entreprise ou d’un autre service, et préfère réinventer une solution maison moins efficace.Dévaluation réactive ( 🔗reactive devaluation)

Nous avons tendance à dévaloriser une proposition simplement parce qu’elle vient d’un adversaire, d’un ex‑partenaire ou d’un groupe qu’on n’aime pas, même si l’idée serait jugée bonne venant de quelqu’un d’autre.

Exemple : dans un conflit familial, une personne rejette automatiquement une suggestion de compromis parce qu’elle vient de son ex‑conjoint, alors qu’elle aurait jugé la même proposition raisonnable si elle était venue d’un ami.Effet de la route familière ( 🔗well‑traveled road effect)

Nous sous‑estimons le temps ou la difficulté des trajets que nous connaissons bien et surestimons ceux des trajets inconnus, simplement parce que la familiarité donne une impression de facilité.

Exemple : avoir l’impression que le trajet habituel pour aller au travail « passe plus vite » qu’un chemin alternatif, alors que les deux durent objectivement le même temps.

Nous simplifions les probabilités et les nombres pour les rendre plus faciles et abordables à notre pensée

Comptabilité mentale ( 🔗 Mental accounting ):

On ne traite pas tout l’argent de la même façon selon “d’où il vient” ou à quoi on l’a mentalement affecté.

Exemple : tu dépenses sans compter une prime ou de l’argent gagné au loto, alors que tu chipotes pour 20 € sur ton salaire “normal”.Erreur d’appel à la probabilité ( 🔗 biais d’évaluation de la probabilité) :

On se trompe sur la probabilité réelle d’un événement, souvent en surestimant les petits risques ou en sous‑estimant les gros.

Exemple : refuser de prendre l’avion parce que “ça s’écrase tout le temps”, mais prendre la voiture sans réfléchir alors qu’elle est statistiquement plus dangereuse.- Biais de normalité ( 🔗 Normality bias):

Le biais de normalité est la tendance à croire que les choses vont continuer comme d’habitude, même quand des signes montrent qu’un changement important ou un danger sérieux arrive.

Exemple du quotidien : malgré les infos sur des fortes intempéries annoncées (inondations, canicule…), une personne continue sa journée comme si de rien n’était, ne protège pas sa maison, ne change pas ses plans, parce qu’“en général, ça se passe bien” et que son cerveau préfère imaginer que tout restera normal. Loi de Murphy ( 🔗 Murphy’s law):

Tendance à ne remarquer et retenir que les situations où “tout va mal”, donnant l’impression que si quelque chose peut rater, ça ratera.

Exemple : tu te dis que “les bus sont toujours en retard” parce que tu te souviens surtout des jours où tu as attendu longtemps, pas des jours où il était à l’heure.Biais de la somme nulle ( 🔗 Zero sum thinking):

Croire que si quelqu’un gagne, quelqu’un d’autre doit forcément perdre, comme si toutes les situations étaient un jeu à somme nulle.

Exemple : penser que si un collègue obtient une augmentation, cela veut dire qu’il y aura moins d’argent disponible pour toi, comme si le “gâteau” était fixe.Biais du survivant ( 🔗 Survivorship bias):

Se baser uniquement sur ceux qui ont “réussi” et ignorer tous ceux qui ont échoué, ce qui fausse la perception de la réalité.

Exemple : croire qu’“il suffit de se lancer sur YouTube pour gagner sa vie” en ne regardant que les gros YouTubeurs et pas les milliers de chaînes qui n’ont jamais percé.Effet de sous‑additivité ( 🔗 Subadditivity effect):

Quand on découpe un risque en plusieurs petites parties, on a tendance à surestimer la somme ou à juger chaque partie comme plus probable isolément.

Exemple : trouver plus probable “avoir un accident en voiture à cause de la pluie, ou de la fatigue, ou d’un autre conducteur distrait” que simplement “avoir un accident en voiture”, alors que ce dernier inclut tout.Effet de la dénomination ( 🔗 Denomination effect):

La façon dont l’argent est présenté (billets, pièces, petites ou grosses coupures) influence la manière dont on le dépense.

Exemple : tu claques beaucoup plus facilement dix pièces de 2 € qu’un billet de 20 €, alors que la valeur est la même.Nombre magique 7 ± 2 ( 🔗 The Magical Number Seven, Plus or Minus Two):

Notre mémoire de travail ne peut manipuler qu’environ 5 à 9 éléments à la fois.

Exemple : tu retiens facilement un numéro de téléphone court dit en blocs (06‑12‑34‑56‑78) mais tu te perds si on te lit une longue suite de chiffres sans pause.

Nous pensons que nous savons ce que les autres pensent

Illusion de transparence ( 🔗 Illusion of transparency) :

Penser que les autres voient clairement ce que l’on ressent ou pense, alors que ce n’est souvent pas le cas.

Exemple : tu es très stressé en réunion, tu es convaincu que tout le monde voit ton stress… alors que personne ne remarque rien de particulier.Malédiction de la connaissance ( 🔗 Curse of knowledge ) :

Une fois qu’on sait quelque chose, on a du mal à imaginer ne pas le savoir et à se mettre à la place de quelqu’un qui débute.

Exemple : un développeur explique un site WordPress à un client avec du jargon technique et ne comprend pas pourquoi le client ne suit pas.Effet de projecteur ( 🔗 Spotlight effect ) :

Surestimer à quel point les autres font attention à nous ou à nos petites erreurs.

Exemple : tu arrives au bureau avec une petite tache sur ton t‑shirt et tu passes la journée à croire que “tout le monde l’a vue”, alors que la plupart n’y ont pas prêté attention.Biais des incitations extrinsèques ( 🔗 Extrinsic incentives bias) :

Se focaliser sur les récompenses ou punitions externes et négliger la motivation intérieure, ce qui peut parfois la détruire.

Exemple : un enfant qui adorait dessiner commence à dessiner uniquement “pour avoir une récompense”, et perd peu à peu le plaisir de dessiner pour le plaisir.Illusion d’agence externe ( 🔗 Illusion of external agency) :

Attribuer ses propres réactions ou préférences à des forces extérieures plutôt qu’à soi‑même.

Exemple : dire “si j’ai eu une bonne note, c’est parce que le prof m’aime bien” ou “si tout va mal, c’est le destin”, au lieu de reconnaître son travail ou ses choix.- Illusion de la connaissance asymétrique ( 🔗 Illusion of asymmetric insight ):

L’illusion de la connaissance asymétrique est la tendance à croire qu’on comprend beaucoup mieux les autres qu’ils ne nous comprennent.

Exemple du quotidien : dans un couple, chacun peut être persuadé de “bien cerner” les réactions et intentions de l’autre (“je sais exactement pourquoi tu fais ça”), tout en pensant que l’autre ne le comprend pas vraiment lui-même, ce qui alimente malentendus et tensions.

Un autre exemple fréquent de l’illusion de la connaissance asymétrique est celui des groupes ou “tribus” (politiques, professionnelles, etc.).

Chaque camp est convaincu de “bien comprendre” les motivations et les biais du camp d’en face (“on sait très bien pourquoi ils votent comme ça / travaillent comme ça”), tout en pensant que ces autres groupes ne comprennent ni leur vision, ni leurs vraies raisons à eux.

Nous projetons nos croyances et schémas de pensées actuels sur le passé et le futur

Biais de cohérence avec soi ( 🔗no ) :

On modifie ses souvenirs ou ses explications pour que tout colle avec l’image qu’on a de soi aujourd’hui.

Exemple : tu dis aujourd’hui que “tu as toujours été écolo”, alors qu’en réalité tu prenais souvent l’avion il y a quelques années, mais tu minimises ou oublies cette période.Biais de retenue ( 🔗 Restraint bias ) :

On surestime notre capacité à résister à une tentation ou à rester raisonnable dans le futur.

Exemple : tu achètes un grand paquet de biscuits en te disant “je ne mangerai que deux par jour”, et tu finis le paquet en deux soirées.Biais de projection ( 🔗 Projection bias) :

On suppose que les autres pensent, ressentent et réagissent comme nous.

Exemple : tu adores travailler le soir sur ton ordinateur et tu t’étonnes que ton/ta partenaire préfère lire un livre et se coucher tôt, en pensant qu’il/elle “exagère”.Biais pro‑innovation ( 🔗 Pro-innovation bias):

Tendance à surestimer les avantages d’une nouveauté et à oublier ses inconvénients ou risques.

Exemple : changer tout ton système de travail pour le “dernier” logiciel à la mode, sans vérifier s’il est stable ni compatible, ce qui te fait finalement perdre du temps.Biais du gain de temps ( 🔗 Time saving bias) :

Croire qu’une nouvelle méthode ou un nouvel outil va forcément faire gagner beaucoup de temps, en sous‑estimant les coûts cachés.

Exemple : accepter un nouveau “super” plugin WordPress pour aller plus vite, puis passer des heures à le configurer et corriger des bugs, pour un gain réel minime.Biais de planification ( 🔗 Planning fallacy ) :

Sous‑estimer systématiquement le temps, le coût ou l’effort nécessaires pour terminer une tâche.

Exemple : annoncer à un client qu’un site sera prêt “en deux semaines”, puis te rendre compte qu’il te faut un mois à cause des contenus, validations et imprévus.Biais de pessimisme ( 🔗 Optimism bias) :

Surestimer la probabilité que les choses se passent mal, surtout pour soi.

Exemple : refuser de lancer ton activité ou d’augmenter tes tarifs parce que tu es convaincu à l’avance que “personne ne paiera jamais ça”.Biais d’impact ( 🔗 Impact bias ) :

Surestimer l’intensité ou la durée de l’effet émotionnel d’un événement futur.

Exemple : penser que si tu perds un client important “ta vie sera fichue pendant des années”, alors que quelques mois plus tard tu t’es adapté et trouvé d’autres clients.Déclinisme ( 🔗 Declinism) :

Croire que “tout va de pire en pire”, que le présent et le futur sont forcément moins bons que le passé.

Exemple : affirmer que “les jeunes ne savent plus travailler, c’était mieux avant”, en oubliant les difficultés et problèmes de l’époque que tu idéalises.Chance morale ( 🔗 Moral luck) :

Juger très différemment une même décision selon son résultat, comme si la chance faisait partie de la morale.

Exemple : trouver irresponsable un ami qui conduit un peu trop vite parce qu’il a eu un accident, mais considérer qu’un autre, qui roule pareil sans accident, “gère bien”.Biais de résultat ( 🔗 Outcome bias) :

Juger la qualité d’une décision uniquement à son résultat, pas à la façon dont elle a été prise.

Exemple : dire qu’un investissement était “forcément une bonne idée” parce qu’il a rapporté de l’argent, même s’il reposait sur de la chance et aucune analyse.Biais rétrospectif ( 🔗 Hindsight bias) :

Penser, après coup, qu’on “savait” que quelque chose allait arriver.

Exemple : après une rupture ou un licenciement, dire “je le sentais depuis le début”, alors que tu ne l’aurais pas prédit clairement avant.Rétrospective de la vie en rose ( 🔗 Rosy retrospection ) :

Tendance à se souvenir du passé comme plus positif qu’il ne l’était vraiment.

Exemple : idéaliser tes années d’études comme “les plus belles de ta vie”, tout en oubliant le stress, le manque d’argent et les disputes de cette période.Effet de télescopage ( 🔗 Telescoping effect ) :

Se tromper sur la date d’un événement passé, en le croyant plus récent ou plus ancien qu’il ne l’est.

Exemple : être convaincu que ton dernier gros projet client date “d’il y a un an maximum”, alors qu’en réalité il remonte à trois ans.

Trop d’information

Nous nous rappelons les choses qui sont déjà amorcées dans notre mémoire ou qui sont souvent répétées

Heuristique de disponibilité ( 🔗 Availability heuristic):

On juge qu’un événement est fréquent ou probable parce qu’on a facilement des exemples en tête.

Exemple : après avoir vu plusieurs reportages sur des cambriolages, tu es persuadé que “ça arrive tout le temps” dans ton quartier, même si les chiffres ne bougent pas.Biais attentionnel ( 🔗 Attentional bias):

Notre attention se focalise surtout sur ce qui confirme nos émotions ou préoccupations du moment.

Exemple : si tu es anxieux à propos de ta santé, tu remarques toutes les infos sur les maladies et ignores les articles rassurants.Effet de vérité illusoire ( 🔗 Illusory truth effect):

À force d’entendre la même information répétée, on finit par la trouver vraie, même sans preuve.

Exemple : un slogan marketing répété partout (“n°1 des ventes”) finit par te sembler crédible, même si tu n’as jamais vu de chiffres.Effet de simple exposition ( 🔗 Mere exposure effect ):

Plus on est exposé à quelque chose, plus on a tendance à l’aimer ou à le trouver acceptable.

Exemple : au début tu trouves un logo moche, puis à force de le voir sur les réseaux et dans la rue, tu t’y habitues et tu le trouves “plutôt sympa”.Effet du contexte ( 🔗 Context effect ):

Le cadre ou l’environnement dans lequel on voit une information influence fortement la façon dont on la perçoit.

Exemple : un même vin paraît meilleur servi dans un beau restaurant avec une belle étiquette que dans un gobelet en plastique à la maison.Échec du rappel sans indice ( 🔗 Cue dependent forgetting):

Difficile de se souvenir d’une info sans aide, alors qu’avec un petit indice elle revient tout de suite.

Exemple : tu n’arrives pas à retrouver le nom d’un film, puis dès qu’on te rappelle le nom d’un acteur qui y joue, le titre te revient.Biais mnésique lié à l’humeur ( 🔗 Mood congruence):

On se rappelle plus facilement des souvenirs qui correspondent à notre humeur du moment.

Exemple : quand tu es triste, tu repenses surtout aux moments difficiles de ta vie et tu oublies les bons souvenirs, ce qui renforce ta tristesse.Illusion de fréquence ( 🔗 Frequency illusion ):

Une fois qu’on découvre quelque chose, on a l’impression de le voir partout.

Exemple : tu apprends un nouveau mot ou tu remarques un modèle de voiture, et tu as l’impression qu’il apparaît soudain tout le temps autour de toi.Phénomène de Baader‑Meinhof ( 🔗 Frequency illusion idem ):

Nom donné à cette illusion de fréquence : ce qu’on vient de remarquer semble se multiplier dans notre environnement.

Exemple : après avoir entendu parler d’une marque de chaussures, tu as l’impression que “tout le monde” en porte alors que tu n’y prêtais simplement pas attention avant.Décalage empathique ( 🔗 Empathy gap ):

On a du mal à se représenter l’état émotionnel d’une personne quand on ne ressent pas la même chose qu’elle.

Exemple : quand tu vas bien, tu comprends mal pourquoi un ami en dépression “n’arrive pas à se motiver”, et tu sous‑estimes la force de ce qu’il vit.Biais d’omission ( 🔗 Omission bias ):

On juge souvent moins sévèrement le fait de ne rien faire que le fait de faire une action qui a un mauvais résultat, même si le dommage est le même.

Exemple : ne pas prévenir un proche d’un risque connu te semble “moins grave” que lui donner un mauvais conseil actif, alors que dans les deux cas il peut avoir un gros problème.Oubli de la fréquence de base ( 🔗 base rate neglect ) :

On ignore les statistiques générales pour se focaliser sur un détail concret de la situation.

Exemple : croire qu’un test médical positif signifie presque sûrement que tu es malade, sans tenir compte du fait que la maladie est très rare et que le test génère beaucoup de faux positifs.

Les choses bizarres, drôles, visuellement frappantes ou anthropomorphiques sont plus saillantes que celles qui ne le sont pas

Effet de bizarrerie ( 🔗 Bizarreness effect ) :

Les choses étranges ou inhabituelles se mémorisent mieux que les choses banales.

Exemple : tu te souviens beaucoup plus d’un client venu déguisé à un rendez‑vous que des dix clients “habillés normalement”.Effet d’humour ( 🔗 Humor effect ) :

Les informations associées à de l’humour sont mieux retenues car elles captent davantage l’attention et les émotions.

Exemple : tu te rappelles très bien d’une pub drôle vue il y a des mois, alors que tu as oublié des pubs plus sérieuses vues la semaine dernière.Effet von Restorff ( 🔗 Von Restorff effect ) :

Un élément qui se démarque fortement des autres (par la couleur, la forme, le ton, etc.) est mieux mémorisé.

Exemple : dans une liste de services présentée en noir, tu te souviens surtout de celui qui était écrit en rouge ou entouré.Effet de supériorité de l’image ( 🔗 Picture superiority effect) :

On retient mieux les images que les mots seuls ; un visuel marque davantage la mémoire qu’un texte équivalent.

Exemple : tu te rappelles facilement du logo d’une marque vue sur Instagram, mais tu as oublié le texte exact de sa baseline.Effet de référence à soi ( 🔗 Self-reference effect) :

On mémorise mieux une information quand on la relie à soi, à son vécu ou à son identité.

Exemple : tu retiens beaucoup mieux une astuce marketing quand tu l’appliques mentalement à ton propre site plutôt qu’à un exemple abstrait.Biais de négativité ( 🔗 Negativity bias ) :

Les informations négatives ont plus de poids sur nos pensées et nos souvenirs que les positives.

Exemple : après une journée avec dix retours clients positifs et un message critique, tu ne penses qu’au commentaire négatif en rentrant chez toi.

On remarque lorsque quelque chose a changé

Ancrage ( 🔗 Anchoring effect ) :

On se laisse fortement influencer par la première information (le “prix de départ”, le premier chiffre, la première impression) et tout le reste est jugé à partir de ce point.

Exemple : si un site affiche un tarif barré à 2 000 € puis “promo” à 1 200 €, tu trouves ça intéressant, alors que si tu avais vu directement 1 200 €, tu l’aurais jugé cher.Conservatisme ( 🔗 Conservatism belief revision ) :

Tendance à rester accroché à ses croyances ou estimations initiales et à ne pas assez les mettre à jour même quand on reçoit de nouvelles informations.

Exemple : tu continues à penser qu’un réseau social “ne sert à rien pour trouver des clients” même après plusieurs preuves que des concurrents y trouvent des prospects.Effet de contraste ( 🔗 Contrast effect ) :

On juge quelque chose en fonction de ce qui vient d’être vu juste avant, ce qui amplifie les différences perçues.

Exemple : un devis à 2 000 € te semble “raisonnable” juste après avoir vu un devis à 4 000 €, mais très cher après un devis à 800 €.Biais de distinction ( 🔗 Distinction bias ) :

Quand on compare deux options côte à côte, on exagère leurs différences, alors que prises isolément elles nous sembleraient presque équivalentes.

Exemple : tu passes des heures à comparer deux hébergeurs qui n’ont que de petites différences de stockage, alors que pris séparément tu les aurais jugés tous les deux “très bien”.Effet de focus ( 🔗 Anchoring effect) :

On accorde trop d’importance à un seul aspect d’une situation et on néglige tout le reste.

Exemple : choisir ton appartement uniquement sur la vue depuis la fenêtre, en oubliant le temps de trajet, le bruit ou le prix de la copropriété.Effet de cadrage ( 🔗 Framing effect ) :

La manière dont une information est formulée (en gain ou en perte, en risque ou en sécurité) change fortement la décision, alors que le fond est identique.

Exemple : accepter plus facilement un devis présenté comme “une opportunité pour augmenter de 30% vos demandes de contact” que le même devis décrit comme “un coût supplémentaire de 500 € par mois”.Illusion monétaire ( 🔗 Money illusion ) :

On se laisse influencer par les montants nominaux (les chiffres affichés) sans tenir assez compte de l’inflation ou du pouvoir d’achat réel.

Exemple : être content d’une augmentation de 50 € par mois alors que, avec l’inflation et les charges, tu peux en réalité acheter moins de choses qu’avant.Loi de Weber‑Fechner ( 🔗 Weber Fechner law ) :

On ne perçoit pas les changements de manière linéaire : plus un stimulus est fort au départ, plus il faut un gros ajout pour remarquer la différence.

Exemple : tu remarques tout de suite une augmentation de 2 € sur un café à 3 €, mais presque pas une hausse de 2 € sur un loyer à 800 €.

Nous sommes attirés par les détails qui confirment nos propres croyances préexistantes

- Biais de confirmation ( 🔗 Confirmation Bias):

On cherche, interprète et retient surtout ce qui confirme ce qu’on pense déjà, en ignorant le reste.

Exemple : si tu es persuadé qu’un CMS est “nul”, tu remarques surtout les bugs et oublies les sites très réussis. Biais de congruence ( 🔗 Congruence bias) :

On teste ou considère presque uniquement l’hypothèse qui nous paraît la plus plausible au départ, sans vraiment explorer d’alternatives.

Exemple : en auditant un site qui convertit mal, tu te concentres seulement sur “le design est mauvais” et tu négliges d’autres pistes comme l’offre ou le texte.Rationalisation post‑achat ( 🔗 Choice supportive bias) :

Après un achat, on se fabrique des arguments pour se convaincre qu’on a pris la bonne décision.

Exemple : tu achètes un ordinateur trop cher et tu répètes “oui mais il est plus puissant, c’est un investissement”, même si tu n’utiliseras jamais toute cette puissance.Biais de soutien du choix ( 🔗 Post purchase rationalization) :

Quand on repense à un choix passé, on “réécrit” un peu l’histoire pour que ce choix ait l’air meilleur qu’il ne l’était.

Exemple : tu te convaincs que choisir tel hébergeur était forcément la meilleure option, et tu minimises les pannes ou lenteurs que tu as subies.Perception sélective ( 🔗 Selective perception ) :

On ne remarque et ne mémorise que les éléments de la réalité qui cadrent avec nos attentes ou nos croyances.

Exemple : si tu penses qu’un client est “difficile”, tu remarques surtout ses critiques et oublies ses compliments.Attente de l’expérimentateur / Biais de l’expérimentateur ( 🔗 Observer-expectancy effect ) :

Les attentes d’une personne qui observe ou mesure peuvent influencer la manière dont elle pose des questions, interprète les réponses ou même le comportement des autres.

Exemple : si tu présentes une nouvelle maquette en disant “c’est une version beaucoup plus moderne”, tes clients seront plus enclins à la trouver moderne.Effet de l’observateur / Biais d’attente ( 🔗 Observer-expectancy effect ) :

Le simple fait d’être observé ou de savoir ce que l’autre attend de nous modifie notre comportement.

Exemple : un client teste ton site devant toi et “s’applique” plus que chez lui, ce qui masque certains problèmes d’ergonomie.Effet de l’autruche ( 🔗 Ostrich effect ) :

Tendance à éviter ou ignorer les informations qui pourraient être négatives ou dérangeantes.

Exemple : ne pas ouvrir les mails de ton comptable ou de l’URSSAF parce que tu as peur d’y voir de mauvaises nouvelles.Validation subjective ( 🔗 Subjective validation ) :

On juge comme “précises” ou “personnelles” des affirmations vagues simplement parce qu’on les relie à son cas.

Exemple : trouver qu’un horoscope générique “te décrit parfaitement” juste parce que tu y repères les phrases qui peuvent correspondre à ta situation.Effet de l’influence continue ( 🔗 Continued influence effect ) :

Une information fausse continue d’influencer nos croyances même après avoir été corrigée.

Exemple : tu entends qu’un réseau social “va fermer”, puis tu apprends que c’était une rumeur, mais tu restes méfiant et hésites à y investir du temps.Réflexe de Semmelweis ( 🔗 Semmelweis reflex ) :

Rejet automatique d’une nouvelle idée parce qu’elle contredit des croyances ou pratiques bien établies.

Exemple : refuser d’envisager un nouveau modèle de facturation ou d’abonnement pour ton activité “parce qu’on n’a jamais fait comme ça”.

- Biais de confirmation ( 🔗 Confirmation Bias):

Nous remarquons les failles chez les autres plus facilement que chez nous-même

Biais de l’angle mort ( 🔗 Bias blind spot ) :

Penser que les autres sont bourrés de biais, mais que nous, nous sommes objectifs et rationnels.

Exemple : tu trouves que tes clients “réagissent de manière irrationnelle” à tes devis, sans envisager que ton propre jugement sur ton offre est, lui aussi, biaisé.Cynisme naïf ( 🔗 Naïve cynicism ) :

Supposer spontanément que les autres agissent surtout par intérêt personnel ou avec des arrière‑pensées cachées.

Exemple : penser qu’un collègue qui t’aide sur un projet “doit forcément y trouver un avantage” plutôt que d’admettre qu’il peut simplement être coopératif.Réalisme naïf ( 🔗 Naïve realism ) :

Croire que l’on voit le monde “tel qu’il est vraiment” et que, s’ils ne sont pas d’accord, les autres sont forcément mal informés, irrationnels ou biaisés.

Exemple : être persuadé que ton point de vue sur la politique ou l’écologie est juste “du bon sens”, et considérer ceux qui pensent autrement comme aveugles ou manipulés.

Que devons-nous nous rappeler ?

Nous stockons les souvenirs différemment selon la façon dont nous avons vécu l’expérience

Effet de profondeur du traitement ( 🔗 Levels of Processing model ) :

Plus on traite une information en profondeur (en la comprenant, en la reliant à d’autres idées), mieux on la retient.

Exemple : tu mémorises beaucoup mieux les fonctionnalités d’un plugin en les appliquant sur un vrai site client qu’en lisant juste la doc.Mot sur le bout de la langue ( 🔗 Tip of the tongue ) :

On sait qu’on connaît un mot, on “sent” qu’il va venir, mais impossible de le retrouver sur le moment.

Exemple : tu veux recommander un thème WordPress précis, tu vois sa couleur, son logo dans ta tête, mais le nom ne vient pas, puis il réapparaît trois heures plus tard sous la douche.Effet Google ( 🔗 Google effect ) :

Quand une information est facilement retrouvable en ligne, on a tendance à moins la mémoriser et à retenir surtout “où” la trouver.

Exemple : tu ne retiens plus les mots de passe ou les réglages serveur, tu sais juste que “tout est dans Google Drive ou dans les mails d’o2switch”.Effet au‑suivant ( 🔗 next‑in‑line) :

On retient mal ce qui est dit juste avant notre tour de parler, parce qu’on est concentré sur ce qu’on va dire soi‑même.

Exemple : en réunion, tu écoutes à moitié la personne qui parle avant toi, occupé à préparer ta prise de parole, et tu es ensuite incapable de résumer ce qu’elle a dit.Effet test ( ( 🔗 Testing effect ):

Le fait de se tester régulièrement (se rappeler l’info de mémoire) améliore beaucoup plus l’apprentissage que de relire encore et encore.

Exemple : tu retiens mieux les étapes pour publier un article optimisé SEO en les réexpliquant de tête à un client que simplement en relisant ton propre tutoriel.Distraction ( 🔗 Absent mindedness ) :

Les distractions (notifications, bruits, pensées intrusives) réduisent la qualité de l’encodage en mémoire et la performance sur la tâche.

Exemple : si tu codes un site tout en répondant aux notifications de ton téléphone, tu oublies plus facilement ce que tu viens de modifier et tu fais plus d’erreurs.

Nous réduisons les événements et listes à leurs éléments-clés

Effet du suffixe ( 🔗 Suffix effect ) :

Un son ou mot ajouté juste après une liste entendue fait baisser le souvenir du dernier élément de la liste.

Exemple : si on te lit une liste de courses puis on ajoute “euh… voilà”, tu te souviens moins bien du dernier article que si la liste s’arrêtait net.Effet de position sérielle / Effet de position dans une série ( 🔗 Serial position effect ) :

On retient surtout les premiers et les derniers éléments d’une liste, et moins ceux du milieu.

Exemple : dans une liste de fonctionnalités présentées à un client, il se souvient mieux de la toute première et de la dernière que de celles au centre.Indiçage partiel ( 🔗 Part-set cuing effect ) :

Donner quelques indices (ex. la première lettre, la catégorie) aide à retrouver une information stockée en mémoire.waren.free+1

Exemple : tu retrouves plus facilement le nom d’un plugin si on te rappelle “celui pour le cache qui commence par W…”.Effet de récence ( 🔗 Recency effect ) :

Les derniers éléments vus ou entendus sont plus faciles à rappeler immédiatement après.

Exemple : après qu’on t’ait listé 10 tâches à faire, tu te souviens surtout des 2–3 dernières.Effet de primauté ( 🔗 Primacy effect ) :

Les premiers éléments d’une liste sont mieux mémorisés que ceux du milieu.

Exemple : dans une liste de menus sur un site, les utilisateurs se souviennent plus facilement du premier onglet que des onglets centraux.Inhibition de la mémoire ( 🔗 Memory inhibition ) :

Certaines informations en mémoire peuvent en bloquer ou en affaiblir d’autres, ce qui gêne le rappel.

Exemple : après avoir souvent appris une nouvelle URL de back‑office, tu as du mal à te rappeler l’ancienne, comme si elle était “cachée” par la nouvelle.Effet de la modalité ( 🔗 Modality effect ) :

On ne mémorise pas pareil selon qu’une liste est entendue ou lue ; l’audition favorise notamment la récence.

Exemple : tu te souviens mieux des derniers points d’une liste entendue à l’oral que d’une liste simplement lue sur écran.Négligence de la durée ( 🔗 Duration neglect ) :

On juge une expérience surtout sur quelques moments clés, sans tenir vraiment compte de sa durée totale.

Exemple : tu trouves qu’un long projet client était “globalement super” parce que le lancement s’est très bien passé, en oubliant les mois de stress.Effet de la longueur de la liste – Effet de position dans une série ( 🔗 Serial recall ) :

Plus une liste est longue, plus il est difficile d’en retenir tous les éléments, surtout ceux du milieu.

Exemple : tu retiens bien les 5 services d’une offre courte, mais tu perds des infos quand tu en présentes 15 d’un coup.Effet de désinformation ( 🔗 Misinformation effect ) :

Des infos fausses ajoutées après coup peuvent modifier le souvenir initial d’un événement.

Exemple : après avoir lu un article inexact sur un bug d’hébergeur, tu te “souviens” que ton site a eu ce bug, alors que ce n’était pas le cas.Nivellement et affinement ( 🔗 Leveling and sharpening ) :

Quand on raconte un souvenir, on a tendance à gommer certains détails (nivellement) et à exagérer ceux qui servent l’histoire (affinement).

Exemple : en racontant un projet compliqué, tu oublies plein de petites étapes mais tu grossis une grosse erreur ou un moment héroïque pour rendre le récit plus frappant.Règle pic‑fin ( 🔗 Peak-end rule ) :

On évalue une expérience surtout selon son moment le plus intense (pic) et sa fin, plutôt que sur l’ensemble.

Exemple : tu gardes un excellent souvenir d’un salon pro parce que tu as fait un super contact à la fin, même si la journée a été fatigante et lente.

Nous écartons les spécificités et formons des généralités

Biais d’affaiblissement de l’affect ( 🔗 Fading affect bias ) :

Les émotions négatives associées à un souvenir ont tendance à s’estomper plus vite que les positives.

Exemple : après quelques mois, tu oublies surtout le stress d’un projet compliqué et tu gardes surtout la fierté du résultat final.Biais de négativité ( 🔗 Negativity bias ) :

Les informations et expériences négatives marquent plus fort et pèsent plus lourd que les positives.

Exemple : après une série d’avis clients très positifs et un seul avis négatif, tu ne penses plus qu’au commentaire critique.Préjugé ( 🔗 Prejudice Préjugé ) :

Jugement négatif ou défavorable porté sur un individu ou un groupe sans les connaître vraiment, souvent basé sur des stéréotypes.

Exemple : supposer qu’un client âgé “ne comprendra rien au numérique” avant même de lui avoir parlé.Mémorisation stéréotypée ( 🔗 Implicit stereotype ) :

On retient mieux ce qui confirme un stéréotype, et on oublie ce qui le contredit.

Exemple : tu te souviens surtout des femmes développeuses qui disent “ne pas aimer les maths”, car cela colle au stéréotype, et tu oublies celles qui excellent en technique.Stéréotype implicite ( 🔗 Implicit stereotype ) :

Association automatique et inconsciente entre un groupe et certaines caractéristiques.

Exemple : associer spontanément “développeur” à un homme et “assistante” à une femme, même si consciemment tu te dis égalitaire.Association implicite ( 🔗 Implicit stereotype ) :

Lien inconscient entre des concepts (ex. un groupe et une qualité positive ou négative), mis en évidence par des tests comme le test d’association implicite.

Exemple : réagir plus vite quand il faut associer “leader” à un prénom masculin qu’à un prénom féminin dans un test, signe d’une association implicite entre leadership et masculin.

Nous modifions et renforçons certains souvenirs après les faits

Effet d’espacement ( 🔗 Spacing effect ) :

On retient mieux une information quand on la révise plusieurs fois, avec des pauses entre les révisions, plutôt qu’en une seule longue session.

Exemple : au lieu de bosser ton SEO une journée entière, tu fais plusieurs sessions courtes réparties sur la semaine, et tu retiens beaucoup mieux les bonnes pratiques.Suggestibilité ( 🔗 Suggestibility ) :

Notre mémoire peut être influencée par des suggestions extérieures, au point d’intégrer des détails qui ne se sont jamais produits.

Exemple : après avoir raconté ton rendez‑vous client, quelqu’un te demande “et quand il s’est énervé ?”, tu finis par te souvenir d’une scène tendue… qui en réalité n’a jamais eu lieu.Faux souvenir ( 🔗 False memory ) :

Souvenir d’un événement qui ne s’est pas produit, ou pas comme on le raconte, mais dont on est pourtant sincèrement convaincu.

Exemple : être persuadé d’avoir déjà livré une fonctionnalité précise sur un site, alors qu’en vérifiant, tu vois qu’elle n’a jamais été développée.Cryptomnésie ( 🔗 Cryptomnesia ) :

Croire qu’une idée vient de soi alors qu’on l’a en fait entendue ou vue ailleurs, la source ayant été oubliée.

Exemple : proposer à un client un concept de logo en pensant l’avoir “eu sous la douche”, alors que tu l’avais aperçu dans un moodboard quelques semaines plus tôt.Confusion de la source ( 🔗 Misattribution of memory ) :

On se souvient d’une information mais on se trompe sur son origine (qui l’a dite, où on l’a vue).

Exemple : tu cites une “étude sérieuse” sur les performances d’un thème, alors que tu l’avais lue dans un simple article de blog d’opinion.Erreur d’attribution de la source ( 🔗 Misattribution of memory ) :

Variante de la confusion de la source : on attribue une information à la mauvaise personne ou au mauvais type de source (expert, média, rumeur…).

Exemple : tu penses qu’un conseil de sécurité vient de la doc officielle de WordPress alors qu’il provient en réalité d’un message lu sur un forum.

Le besoin d’agir vite

Nous favorisons les options qui nous paraissent simples ou qui ont des informations plus complètes aux options plus complexes ou ambiguës

Effet moins‑c’est‑mieux ( 🔗 Less is better effect ) :

Quand deux options sont évaluées séparément, on peut préférer celle objectivement moins bonne parce qu’elle “sonne mieux” ou paraît plus cohérente.

Exemple : des clients sont plus contents d’un petit service irréprochable que d’un gros pack incluant quelques éléments de moindre qualité.Rasoir d’Ockham ( 🔗 Occam’s razor ) :

Principe qui pousse à choisir, parmi plusieurs explications possibles, celle qui est suffisamment explicative et la plus simple.

Exemple : si ton site rame, tu examines d’abord les causes simples (hébergement, plugin lourd, images non optimisées) plutôt qu’un hypothétique piratage ultra‑sophistiqué.Erreur de conjonction ( 🔗 Conjunction fallacy ) :

Croire qu’une combinaison de deux événements détaillés est plus probable qu’un seul événement plus général.

Exemple : penser qu’il est plus probable qu’un client soit “photographe freelance spécialisé mariage” que simplement “photographe”, alors que la seconde option est forcément plus probable.Loi de futilité de Parkinson / Effet abri à vélo ( 🔗 Law of triviality ) :

On consacre trop de temps à des sujets simples et secondaires, et pas assez aux sujets complexes mais essentiels.

Exemple : passer une heure à débattre de la couleur d’un bouton sur un site et cinq minutes sur la stratégie de contenu ou le budget global.Effet “ça rime donc c’est bon” ( 🔗 Rhyme as reason effect ) :

Une phrase qui rime paraît plus vraie ou plus fiable, simplement parce qu’elle est fluide et agréable à l’oreille.

Exemple : un slogan du type “Moins de stress, plus de succès” semble plus crédible qu’une formulation plus banale exprimant la même idée.Biais de croyance ( 🔗 Belief bias ) :

On juge un argument en fonction de ce que l’on croit déjà, plutôt que sur sa logique réelle.

Exemple : tu trouves “convaincant” un article sur le télétravail s’il va dans ton sens, même s’il est mal argumenté, et tu rejettes un bon article qui dit l’inverse.Biais d’information ( 🔗 Information bias ) :

Penchant à chercher toujours plus d’informations, même lorsqu’elles n’apportent plus de vraie valeur pour la décision.

Exemple : continuer à comparer des dizaines de thèmes ou d’hébergeurs alors que tu as déjà assez d’éléments pour choisir, ce qui retarde ton lancement.Effet d’ambiguïté ( 🔗 Ambiguity effect ) :

Tendance à éviter les options dont les probabilités ou conséquences ne sont pas clairement connues.

Exemple : refuser une nouvelle plateforme de prise de rendez‑vous parce que tu ne connais pas bien son fonctionnement, tout en restant sur un système moins performant mais familier.

Pour éviter de faire des erreurs, nous avons tendance à préserver notre autonomie et notre statut de groupe et à éviter les décisions irréversibles

Biais du statu quo ( 🔗 Status quo bias ) :

Préférence pour la situation actuelle, même si une alternative pourrait être meilleure, parce que tout changement paraît risqué ou fatigant.

Exemple : garder un ancien thème ou hébergeur “par habitude”, alors qu’un changement améliorerait clairement les performances.Biais de comparaison sociale ( 🔗 Social comparaison bias ) :

Se juger en se comparant sans cesse aux autres, ce qui influence fortement satisfaction, estime de soi et choix.

Exemple : te sentir “nul” parce que tu compares ton chiffre d’affaires aux posts LinkedIn très flatteurs d’autres freelances.Effet de dominance asymétrique ( 🔗 effet de leurre/decoy effect) :

Ajouter une troisième option moins intéressante oriente inconsciemment vers l’option que l’on veut faire choisir.

Exemple : proposer trois offres de site web, dont une clairement moins bonne mais proche de l’offre “premium”, pour pousser les clients à choisir cette offre premium.Réactance ( 🔗 Reactance ) :

Réaction de résistance quand on a l’impression que quelqu’un menace ou restreint notre liberté de choix.

Exemple : un client refuse une solution pourtant pertinente simplement parce qu’il a le sentiment qu’on lui “impose” cette option sans lui laisser la main.Psychologie inversée ( 🔗 Reverse psychology ) :

Technique qui consiste à suggérer à quelqu’un de faire le contraire de ce que l’on souhaite, en misant sur sa réactance.

Exemple : dire à un client très têtu “vous pouvez bien sûr garder ce vieux logo, il vous va très bien”, en espérant qu’il réclame lui‑même une refonte.Justification du système ( 🔗 System justification theory ) :

Tendance à considérer que le système en place (social, économique, organisationnel) est fondamentalement juste et légitime, même s’il est défavorable.

Exemple : accepter des conditions de plateformes ou des commissions abusives en te disant “c’est comme ça, on ne peut rien y faire, s’ils font ça c’est qu’il y a une raison”.

Pour accomplir nos tâches, nous avons tendance à vouloir compléter celles dans lesquelles nous avons déjà investi du temps et de l’énergie

Effet boomerang ( 🔗 Backfire effect ) :

Une tentative de convaincre quelqu’un produit l’effet inverse et renforce sa position initiale.

Exemple : une campagne très moralisatrice contre le tabac pousse certains ados à fumer “pour montrer qu’on ne leur dicte pas leur conduite”.Effet de dotation ( 🔗 Endowment effect ) :

On accorde plus de valeur à ce qu’on possède déjà qu’à la même chose avant de la posséder.

Exemple : tu trouves ton vieux logo “très bien” et refuses de le changer, simplement parce que c’est le tien.Effet de difficulté de traitement ( 🔗 Processing difficulty effect ) :

Une information qui demande plus d’effort mental (illisible, compliquée) est souvent jugée plus risquée, moins crédible ou moins attirante.

Exemple : une offre écrite en tout petit, avec un jargon compliqué, te semble spontanément plus louche qu’une présentation claire et lisible.Effet de pseudo‑certitude ( 🔗 Pseudocertainty effect ) :

On préfère un petit gain quasi sûr à un gain plus important mais incertain, surtout quand la situation est présentée de façon rassurante.

Exemple : choisir un forfait plus cher avec “garantie de résultat” plutôt qu’un forfait potentiellement plus rentable mais sans promesse forte.Effet de disposition ( 🔗 Disposition effect ) :

Tendance à “prendre ses gains” trop tôt et à garder trop longtemps ce qui perd, par difficulté à accepter une perte.

Exemple : garder un service ou une offre qui ne fonctionne pas “en espérant que ça finisse par marcher”, tout en arrêtant trop vite des pistes qui commençaient à peine à donner des résultats.Biais du risque zéro ( 🔗 Zero Risk bias ) :

Chercher à éliminer complètement un petit risque plutôt que de réduire fortement un gros risque.

Exemple : passer des heures à sécuriser un détail très improbable sur un site, mais négliger des sauvegardes régulières qui couvriraient la majorité des vrais problèmes.Biais de la portion ( 🔗 List ) :

Plus la portion est grande, plus on consomme, même sans avoir plus faim ou plus besoin

Exemple : proposer un “gros pack de services” fait que le client en prend plus qu’il ne lui en faut vraiment, simplement parce que l’offre est plus grande.Effet IKEA ( 🔗 IKEA effect ) :

On valorise davantage ce qu’on a construit ou personnalisé soi‑même, même si la qualité est moyenne.

Exemple : tu trouves ton site “canon” parce que tu as passé des heures dessus, alors qu’un regard extérieur voit encore beaucoup de défauts.Aversion à la perte ( 🔗 Loss aversion ) :

Perdre fait plus mal que gagner ne fait plaisir, pour un même montant.

Exemple : tu es plus contrarié de perdre un client à 500 € par mois que tu n’es heureux d’en gagner un nouveau au même tarif.Effet de génération d’information ( 🔗 Generation effect ) :

On retient mieux une information quand on la produit soi‑même que lorsqu’on la lit simplement.

Exemple : tu mémorises mieux les arguments de vente d’un site en les rédigeant toi‑même qu’en recopiant un modèle tout fait.Escalade d’engagement / Escalade irrationnelle ( 🔗 Escalation of commitment ) :

Continuer à investir dans un projet qui va mal, parce qu’on y a déjà mis du temps, de l’argent ou de l’énergie.

Exemple : persister sur une refonte de site bancale depuis des mois “parce qu’on a déjà tellement investi dessus”, au lieu de repartir sur une base plus saine.Biais des coûts irrécupérables ( 🔗 Sunk cost ) :

Justifier la poursuite d’un projet en faillite à cause des ressources déjà dépensées, alors qu’elles sont perdues quoi qu’il arrive.

Exemple : garder un abonnement logiciel inutile parce que “tu l’as déjà payé pour l’année”, au lieu de l’arrêter et de limiter les pertes.

Afin de rester concentré, nous favorisons ce qui nous est immédiat, proche ou autour de nous

Effet de la victime identifiable ( 🔗 Identifiable victim effect ) :

On ressent plus d’empathie et on aide plus facilement une personne précise avec un nom et un visage qu’un grand groupe anonyme.

Exemple : tu es plus touché par l’histoire détaillée d’un commerçant local en difficulté que par des chiffres globaux sur “les petites entreprises en crise”.Appel à la nouveauté ( 🔗 Appeal to novelty ) :

Tendance à juger qu’une chose est meilleure simplement parce qu’elle est nouvelle ou récente.

Exemple : vouloir absolument refondre ton site ou changer de smartphone dès qu’une “nouvelle version” sort, même si l’ancienne répond encore parfaitement à tes besoins.Rabais hyperbolique ( 🔗 actualisation hyperbolique – Hyperbolic discounting ) :

Préférence pour une petite récompense immédiate plutôt qu’une récompense plus importante mais plus tard.

Exemple : accepter un petit projet mal payé mais tout de suite, au lieu de consacrer du temps à prospecter pour décrocher un contrat plus rémunérateur dans quelques semaines.

Pour pouvoir agir, nous devons avoir confiance en notre capacité à avoir un impact et sentir que ce que nous faisons est important

Effet Peltzman / Compensation du risque ( 🔗 Risk compensation ) :

Quand on se sent plus protégé, on prend souvent plus de risques, ce qui annule une partie des bénéfices de la sécurité.

Exemple : un conducteur roule plus vite parce qu’il a l’ABS et l’ESP, au lieu de rouler aussi prudemment qu’avant.Justification de l’effort ( 🔗 Risk compensation ) :

Plus on a souffert ou investi pour obtenir quelque chose, plus on le juge précieux ou de qualité.

Exemple : tu trouves “forcément utile” une formation très chère et exigeante, simplement parce que tu y as consacré beaucoup de temps et d’argent.Biais d’attribution des traits ( 🔗 Trait ascription bias ) :

Tendance à expliquer le comportement des autres par leurs “traits de caractère” plutôt que par la situation.

Exemple : dire “ce client est mal organisé” plutôt que “il est débordé en ce moment à cause d’un pic d’activité”.Hypothèse d’attribution défensive ( 🔗 Defensive attribution hypothesis ) :

On modifie nos explications pour se rassurer et croire qu’un malheur ne pourrait pas nous arriver.

Exemple : après avoir entendu qu’un freelance s’est fait arnaquer, tu te dis “il devait être négligent”, pour ne pas envisager que ça pourrait aussi t’arriver.Erreur fondamentale d’attribution ( 🔗 Fundamental attribution error ) :

On surestime les causes internes (personnalité) pour expliquer le comportement des autres et on néglige le contexte.

Exemple : penser qu’un livreur en retard est “incompétent”, sans tenir compte des bouchons ou d’un problème de logistique.Supériorité illusoire / Effet Lac Wobegon ( 🔗 Illusory superiority ) :

Se croire au‑dessus de la moyenne sur de nombreuses qualités (compétence, conduite, intelligence…).

Exemple : être convaincu d’être “meilleur que la plupart” en design ou en gestion de projet, sans éléments objectifs pour le prouver.Illusion de contrôle ( 🔗 Illusion of control ) :

Croire qu’on contrôle des événements largement dépendants du hasard ou de facteurs externes.

Exemple : penser qu’en “surveillant souvent” tes stats tu maîtrises totalement l’arrivée de nouveaux clients, alors que beaucoup dépend du marché ou d’algorithmes.Effet acteur‑observateur ( 🔗 Actor observer asymmetry ) :

Pour nous‑mêmes, on invoque surtout la situation ; pour les autres, on invoque surtout leur caractère.

Exemple : si tu rends un travail en retard, tu parles de “contrainte client et imprévus”, mais si un collègue est en retard, tu penses qu’il est peu fiable.Biais d’autocomplaisance ( 🔗 Self-serving bias ) :

Tendance à attribuer ses réussites à soi (talent, effort) et ses échecs à des causes externes.

Exemple : attribuer un site qui marche bien à ton génie, et un site qui convertit mal au “mauvais brief du client”.Effet Barnum / Effet Forer ( 🔗 Barnum effect ) :

On trouve très pertinentes des descriptions de personnalité vagues et générales, comme si elles étaient taillées sur mesure.

Exemple : lire un portrait “vous êtes parfois sociable, parfois réservé” et avoir l’impression que c’est exactement toi.Biais d’optimisme ( 🔗 Optimism bias ) :

Penser que les choses se passeront mieux pour soi que pour les autres, et sous‑estimer les risques.

Exemple : te dire que “les impayés, ça arrive aux autres”, et ne pas mettre en place de conditions générales ou d’acomptes.Biais égocentrique ( 🔗 Egocentric bias ) :

Se centrer sur son propre point de vue et surestimer son rôle dans les événements.

Exemple : croire que si un projet commun se passe bien, c’est surtout grâce à toi, et s’il se passe mal, c’est surtout à cause des autres.Effet Dunning‑Kruger ( 🔗 Dunnig-Kruger effect 🔗 The lake Wobegon effect) :

Les moins compétents surestiment souvent leur niveau, tandis que les plus compétents peuvent se sous‑estimer.

Exemple : quelqu’un qui vient de découvrir WordPress se croit déjà capable de “tout faire comme une agence”, alors qu’il ignore ce qu’il ne sait pas encore.Effet Lac Wobegon ( 🔗 The lake Wobegon effect):

L’effet du lac Wobegon (ou biais de supériorité illusoire) désigne la tendance à se croire au‑dessus de la moyenne sur beaucoup de plans (intelligence, compétence, moralité, conduite, etc.), en surestimant ses qualités et en minimisant ses défauts.

Exemple concret :8 personnes sur 10 se pensent “meilleurs conducteurs que la moyenne”, alors que mathématiquement c’est impossible pour tout le monde. Au travail, beaucoup de gens se jugent plus compétents ou plus sérieux que leurs collègues, ou pensent “je repère mieux les fake news que les autres”, ce qui peut les rendre moins vigilants face à leurs propres erreurs et croyances.Effet difficile‑facile ( 🔗 Hard easy effect ) :

On surestime ses performances sur les tâches difficiles et on les sous‑estime sur les tâches faciles.

Exemple : penser que tu vas gérer sans problème un énorme projet multi‑sites, mais douter de ta capacité à faire une simple landing page ultra‑optimisée.- Effet de faux consensus ( 🔗 False consensus effect ) :

Croire que les autres pensent et agissent plus comme nous que ce n’est réellement le cas.

Exemple : supposer que “tout le monde préfère un site sombre” parce que toi et quelques amis aimez ce style. - Effet “troisième personne” ( 🔗 Third person effect ) :

Penser que les autres sont beaucoup plus influencés que nous par la pub, les médias ou la manipulation.

Exemple : croire que “la pub ne marche pas sur toi, seulement sur les autres”, tout en étant toi‑même sensible aux promotions et aux avis. - Désirabilité sociale ( 🔗 Social desirability bias ) :

Adapter ce qu’on dit ou montre pour paraître sous un jour favorable aux yeux des autres.

Exemple : enjoliver un peu ton chiffre d’affaires ou ton nombre de clients quand tu te présentes sur LinkedIn. - Biais d’excès de confiance ( 🔗 Overconfidence effect ) :

Surestimer la précision de ses jugements ou prévisions.

Exemple : annoncer un délai très serré à un client en étant sûr de le tenir, puis devoir courir ou bâcler pour essayer de rester dans les temps.

Cette page est publiée sous licence Creative Commons Attribution et partagée dans les Mêmes Conditions 4.0 International (CC BY‑SA 4.0).

Des modifications et reformulations ont été apportées sur l’ensemble des articles. Cette page reprend les 188 biais cognitifs de l’image de Codex des biais cognitifs de John Manoogian III (jm3).